ช่วงนี้หลายคนเริ่มรู้สึกเหมือนกันว่า AI รุ่นใหม่ ๆ ไม่ได้แข่งกันแค่ตอบถูกแล้ว แต่แข่งกันที่ ใครช่วยทำงานจริงได้มากกว่า

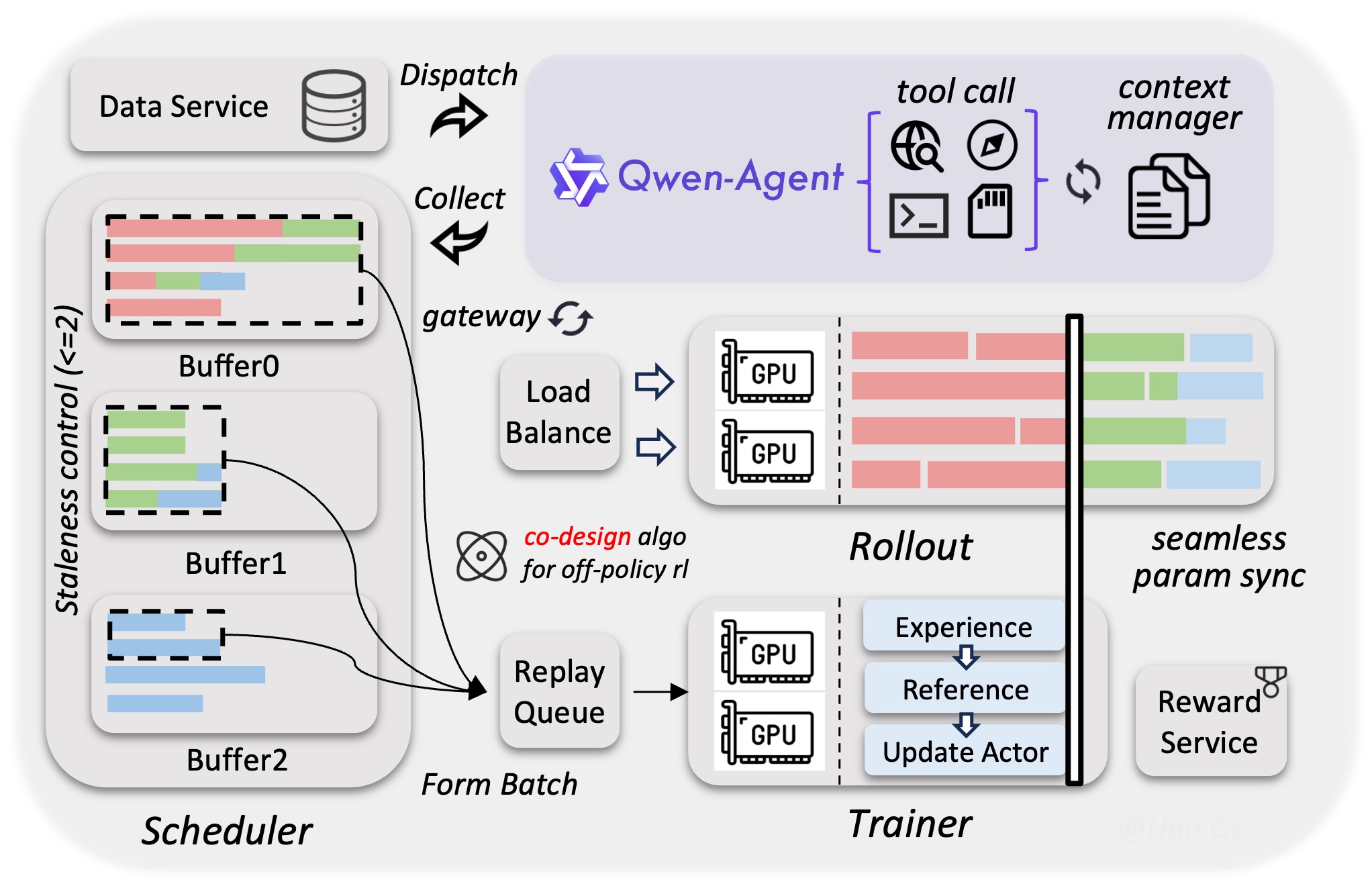

16 กุมภาพันธ์ 2569 Alibaba เปิดตัว Qwen3.5 โมเดล AI ปล่อยออกมาเพื่อดันไปทาง Native Multimodal Agent (โมเดลที่เกิดมาให้เข้าใจได้ทั้ง ข้อความ + ภาพ และต่อยอดไปทำงานแบบ Agent ได้) สามารถประยุกต์ได้ทั้ง Reasoning, Coding, Agent, และ Multimodal understanding (เข้าใจหลายโมดูล)

Qwen3.5 มีกี่รุ่น ทำหน้าที่อะไร

Qwen3.5 ถูกวางเป็นโมเดลที่

- อ่าน/เข้าใจได้ทั้งข้อความและภาพ (vision-language)

- ช่วยคิดเป็นขั้น, เขียนโค้ด, ทำงานแบบ agent และใช้เครื่องมือได้ (เช่น search / code interpreter ในบริการที่โฮสต์)

Qwen3.5 มี 2 รุ่น

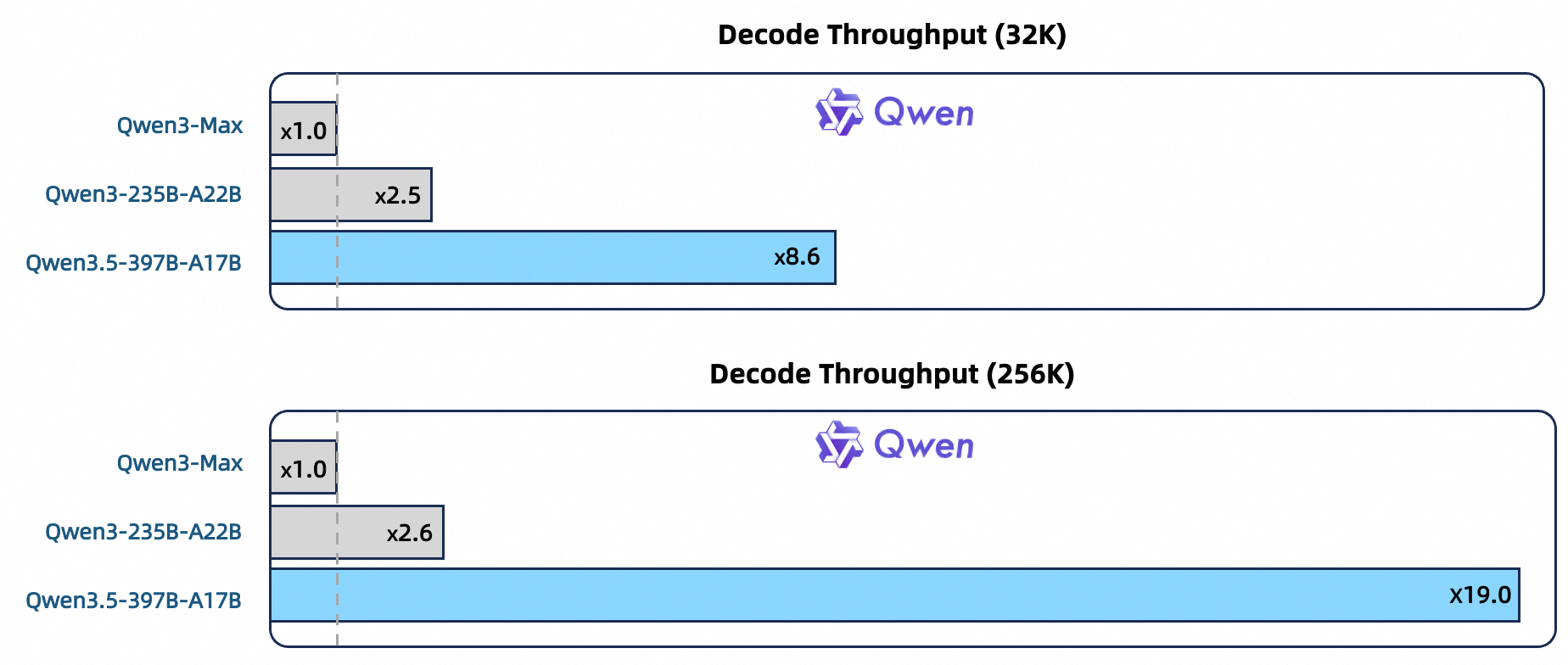

- Qwen3.5-397B-A17B

- รุ่น open-weight เป็น native vision-language และใช้สถาปัตยกรรมแบบ MoE ที่รวม 397B ใช้จริง 17B ต่อครั้ง ทำงานไวขึ้น และ คุมต้นทุนได้ง่ายขึ้น เวลาเอาไปรันใช้งานจริง

- Qwen3.5-Plus

- รุ่น hosted บน Alibaba Cloud Model Studio

- จุดขาย คือ Context Window 1M และมี built-in tools + adaptive tool use เน้นทำงานจริงให้ Dev และองค์กรทำงานไวขึ้น และอ่านข้อมูลยาว ๆ แล้วไม่หลุด เหมาะกับงานเอกสารเยอะ ๆ งานประชุมยาว ๆ งานรีเสิร์ช และโปรเจกต์ที่มีรายละเอียดจุกจิก

เอาไปทำอะไรได้บ้าง

- สรุปรายงาน/สไลด์/ไฟล์เอกสารให้ผู้บริหารแบบสั้น ๆ

- ช่วยทีมขายทำสรุปคู่แข่ง + เปรียบเทียบ + ทำเป็น one-pager

- ช่วยทีมคอนเทนต์ทำโพสต์จากข้อมูลยาว ๆ ให้สั้นและเข้าใจง่าย

- ช่วยทีม Dev ทำงาน Vibe Coding ผ่านเครื่องมือที่ต่อกับโมเดลได้

- งานที่ต้องดูภาพ + ข้อความ แล้วตัดสินใจ เช่นเคสซัพพอร์ต/เคสเอกสาร

Qwen3.5 สามารถใช้งานร่วมกับ OpenClaw เพื่อช่วยงานด้านโค้ดได้ โดยเมื่อเชื่อมกับ OpenClaw จะสามารถ

- ทำ web search ได้

- รวบรวมข้อมูลได้

- สรุปออกมาเป็น รายงานแบบมีโครงสร้าง (structured reports) ได้

ข้อสรุป:

Qwen3.5 AI ที่ไม่ได้แค่ตอบคำถาม แต่ทำงานเป็นชุดได้เลย ตั้งแต่ช่วยคิด ช่วยหาข้อมูล จนถึงเรียบเรียงออกมาเป็นงานที่ส่งต่อให้ทีมได้จริง

พอจับคู่กับ OpenClaw มันเหมือนมีผู้ช่วยที่เข้าใจโจทย์แล้วลงมือไล่ทำให้ครบวงจร งานโค้ดกับงานรีเสิร์ชเลยเร็วขึ้นและหลุดน้อยลง