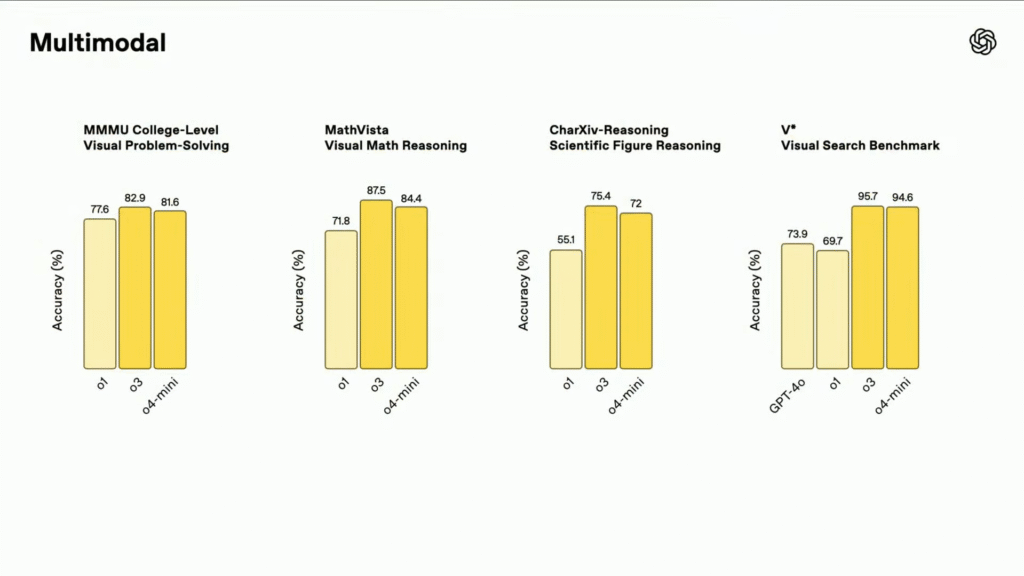

บริษัท OpenAI เปิดตัว o3 และ o4-mini โมเดล AI ใหม่ที่ไม่เพียงแค่ เห็นภาพ แต่ยังสามารถ คิดโดยใช้ภาพที่ฉลาดกว่าเดิม ตอบโจทย์ทั้งผู้ใช้ทั่วไปจนถึงนักวิจัยขั้นสูง ด้วยความสามารถในการคิดวิเคราะห์ การประมวลผลภาพ และการใช้เครื่องมืออัตโนมัติ พร้อมประสิทธิภาพและความปลอดภัยที่ดียิ่งขึ้น

เปิดตัว o3, o4-mini

16 เมษายน 2568 ตามเวลาอเมริกา บริษัท OpenAI เปิดตัว o3 และ o4-mini เป็นโมเดลรวมความสามารถด้านการคิดวิเคราะห์เข้ากับการใช้เครื่องมือแบบหลายโหมด

o3 โมเดลตัว Top ด้าน Reasoning & Coding

เหมาะสำหรับงานยาก ๆ เช่น การเขียนโค้ด การแก้โจทย์คณิตศาสตร์ หรือการวิเคราะห์ภาพ และลดข้อผิดพลาดของคำตอบลงถึง 20% เมื่อเทียบกับรุ่นก่อนหน้า

o4-mini โมเดลขนาดเล็ก ฉลาด เร็วและประหยัด

เหมาะกับผู้ใช้งานทั่วไป เน้นคุณภาพในราคาเบา ๆ แต่ยังคงประสิทธิภาพยอดเยี่ยมในด้านคณิตศาสตร์ การเขียนโค้ด และการวิเคราะห์ภาพ

ความสามารถ o3 และ o4 mini (low-medium-high)

- วิเคราะห์เชิงลึก เพื่อแก้โจทย์ซับซ้อน เช่น การวิเคราะห์ข้อมูลธุรกิจ, ฟิสิกส์ หรือภาพกราฟิก

- ใช้เครื่องมือเองได้ : มันสามารถค้นหาเว็บ เขียนโค้ด Python หรือปรับแต่งภาพเองได้โดยไม่ต้องรอคนสั่ง

- รองรับโหมด Multimodal (ข้อความ + ภาพ) และ Thinking with Images วิเคราะห์ประมวลผลภาพ เพื่อคำตอบที่แม่นยำและละเอียดขึ้น

- เขียนโค้ดและพัฒนา Software เก่งขึ้น

โมเดลสามารถค้นหาข้อมูลสาธารณูปโภคจากเว็บ เขียนโค้ด Python เพื่อสร้างการพยากรณ์ สร้างกราฟหรือภาพ และอธิบายปัจจัยสำคัญที่อยู่เบื้องหลังการคาดการณ์ได้ โดยการเชื่อมโยงการใช้เครื่องมือหลายตัว

o3 และ o4-mini มี Thinking with Images สามารถนำภาพมาวิเคราะห์และประมวลผลในกระบวนการคิด เพื่อสร้างคำตอบที่แม่นยำและละเอียดขึ้น เหมาะสำหรับแก้ปัญหาซับซ้อนที่เกี่ยวข้องกับภาพหรือข้อมูลหลายรูปแบบ

ตัวอย่างทั้งหมดถูกทำขึ้นด้วย OpenAI o3

- อ่านลายมือ

- แก้โจทย์ปัญหา

- อ่านป้ายบอกทาง

- ค้นหาตารางเวลารถบัส

และทำงานร่วมกับเครื่องมืออื่นๆ เช่น การวิเคราะห์ข้อมูล Python การค้นหาเว็บ การสร้างภาพ

ตัวอย่างเช่น

- แก้เขาวงกต

- ค้นหาวันที่ของเหตุการณ์

- รับเกร็ดความรู้เกี่ยวกับสถานที่

- แก้ปริศนา

ภาพของการประมวลผลแก้เกมเขาวงกต

สิ่งที่ทำได้:

– อัปโหลดภาพ เช่น Sketch, Whiteboard หรือแผนภูมิ และโมเดลจะวิเคราะห์ได้แม้ภาพจะเบลอหรือกลับด้าน

– ปรับแต่งภาพในระหว่างการคิด เช่น การหมุน ซูม หรือครอบตัด เพื่อดึงข้อมูลสำคัญ

– แก้โจทย์ปัญหาจากภาพ เช่น การอ่านลายมือ วิเคราะห์กราฟ หรือแก้ปริศนา

– แปลงภาพเป็นส่วนหนึ่งของการคิด เช่น การสร้างสมมติฐานใหม่จากข้อมูลภาพ

– ผสานการคิดวิเคราะห์ระหว่างภาพและข้อความ เพื่อตอบคำถามที่ซับซ้อน

ข้อจำกัด

– กระบวนการคิดยาวเกินไป: โมเดลอาจใช้เครื่องมือหรือปรับแต่งภาพซ้ำซ้อนโดยไม่จำเป็น

– ข้อผิดพลาดการรับรู้: ตีความภาพผิดอาจทำให้คำตอบสุดท้ายไม่ถูกต้อง

– ความน่าเชื่อถือ: ผลลัพธ์อาจเปลี่ยนแปลงในแต่ละครั้งที่แก้ปัญหา

ความปลอดภัยของ o3 และ o4-mini

เราปรับปรุงข้อมูลฝึกฝนด้านความปลอดภัยใหม่ทั้งหมด เช่น ภัยคุกคามทางชีวภาพ (biorisk), การสร้าง MAlware และ jailbreak ส่งผลให้โมเดลมีประสิทธิภาพสูงในการป้องกันคำสั่งเสี่ยง อีกทั้งเรายังใช้ LLM monitor ตรวจสอบบทสนทนาในพื้นที่เสี่ยง ซึ่งตรวจจับได้ถึง 99% ในแผนทดสอบ

เพิ่มเติม

– o3 และ o4 mini ผู้ใช้แผน Plus, Pro, Team ได้สิทธิ์เข้าถึงก่อน เริ่มวันนี้

– o3 และ o4 mini สำหรับ Developers พร้อมใช้งานผ่าน Chat Completions API และ Responses API ตั้งแต่วันนี้

– Responses API ของ o3 และ o4 mini รองรับสรุปการคิดวิเคราะห์ การเก็บโทเคนการคิดวิเคราะห์ไว้ และการเรียกฟังก์ชันเพื่อเพิ่มประสิทธิภาพ

– ภายใน 1 สัปดาห์ ผู้ใช้งานแผน Enterprise และ Edu จะสามารถเข้าถึงโมเดล o3 และ o4-mini

– ผู้ใช้ฟรีสามารถลองใช้ o4-mini โดยเลือก Think ก่อนส่งคำถาม

– o3-pro ออกมาในอีกไม่กี่สัปดาห์ข้างหน้า โดยจะมีการสนับสนุนเครื่องมือแบบเต็ม

– ผู้ใช้แผน Pro ยังสามารถเข้าถึง o1-pro ได้เหมือนเดิม

ราคา API

o3

Input tokens 10 ดอลลาร์สหรัฐฯ/1 ล้าน Tokens

Output Tokens 40 ดอลลาร์สหรัฐฯ/1 ล้าน Tokens

o4-mini

Input tokens 1.1 ดอลลาร์สหรัฐฯ/1 ล้าน Tokens

Output Tokens 4.4 ดอลลาร์สหรัฐฯ/1 ล้าน Tokens

เหมาะกับใครบ้าง

– คนทั่วไปที่อยากถามคำถามซับซ้อน เช่น “พลังงานในฤดูร้อนปีนี้จะเป็นยังไง?”

– นักธุรกิจที่ต้องการวิเคราะห์ข้อมูลตลาด

– นักเรียน/นักศึกษาที่ต้องการแก้โจทย์คณิตศาสตร์หรือวิทยาศาสตร์

– นักพัฒนาที่ต้องการเขียนโค้ดหรือแก้ไขโปรแกรม

ข้อสรุป:

o3 และ o4-mini เป็นโมเดลใหม่ที่จะช่วยให้ผู้นำและนักธุรกิจทำงานได้เร็วขึ้นและแม่นยำขึ้น ไม่ว่าจะเป็นการวิเคราะห์ข้อมูล การพัฒนาผลิตภัณฑ์ หรือการแก้ปัญหาเฉพาะหน้า

Source:

OpenAI Index 1, OpenAI Index 2, Thinking with Images, Techcrunch, Youtube