เผยแพร่: 7 เมษายน 2569

สรุปใจความสำคัญ

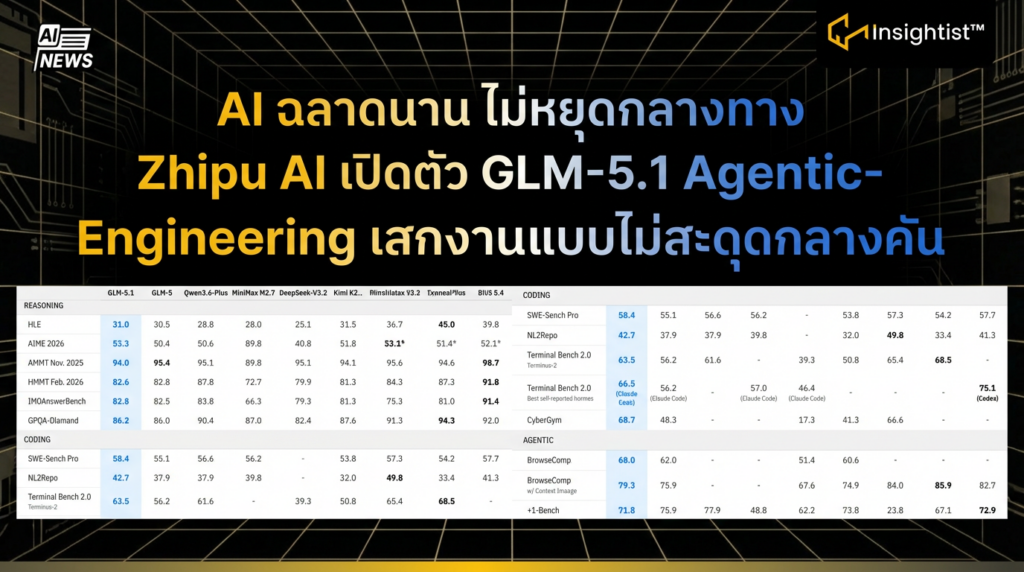

- Zhipu AI เปิดตัว GLM-5.1 โมเดลโอเพนซอร์สที่ออกแบบมาเพื่อ Agentic Engineering โดยเฉพาะ

- ทำงานแบบ “คิด-ทำ-วัด-ปรับ” ได้ต่อเนื่องกว่า 600 รอบ โดยไม่หยุดกลางคัน เพิ่มประสิทธิภาพงานได้สูงสุด 6 เท่า

- ใช้งานฟรีภายใต้ใบอนุญาต MIT รองรับ vLLM, SGLang และพร้อมเชื่อมต่อกับ Claude Code

- เหมาะกับธุรกิจที่ต้องการระบบ AI ที่ทำงานแบบมาราธอน แก้โจทย์ซับซ้อนได้โดยไม่มีเมตริกชัดเจน

GLM-5.1 คืออะไร และทำไมถึงต่างจากโมเดลทั่วไป?

GLM-5.1 โดย Zhipu AI คือโมเดลภาษาขนาดใหญ่ที่ออกแบบมาสำหรับงาน “Agentic Engineering” โดยเฉพาะ ซึ่งหมายถึงความสามารถในการวางแผน ดำเนินการ ประเมินผล และปรับปรุงตัวเองได้อย่างต่อเนื่อง โดยไม่ต้องรอคำสั่งจากมนุษย์ในทุกขั้นตอน

ต่างจากโมเดลทั่วไปที่มักหยุดทำงานหลัง 50-100 รอบการรัน (inference steps) GLM-5.1 ถูกสร้างมาให้ทำงานแบบลูปไม่จำกัด ตราบใดที่ยังมีเป้าหมายให้บรรลุ ทำให้เหมาะสำหรับงานวิศวกรรมซอฟต์แวร์ การปรับแต่งฐานข้อมูล หรือการพัฒนาแอปพลิเคชันที่ต้องการการทดสอบและปรับปรุงซ้ำๆ

GLM-5.1 ทำงานได้ดีแค่ไหนในทางปฏิบัติ?

จากการทดสอบจริงกับงานปรับแต่งฐานข้อมูล GLM-5.1 สามารถเพิ่มประสิทธิภาพจาก 3,500 เป็น 21,500 หน่วย หรือดีขึ้นถึง 6 เท่า โดยทำงานวนลูปกว่า 600 รอบ และเรียกเครื่องมือตรวจสอบตัวเอง (self-verification tools) กว่า 6,000 ครั้ง

จุดเด่นที่สำคัญ:

- Agentic Engineering แบบเต็มรูปแบบ: สามารถแยกย่อยปัญหาซับซ้อน รันการทดลอง อ่านผลลัพธ์ และปรับกลยุทธ์ใหม่ได้เอง

- ยืดหยุ่นกับงานที่ไม่มีเมตริกชัดเจน: แม้แต่การสร้าง Linux Desktop แบบ Web Application ที่ไม่มีตัวเลขให้ Optimize โมเดลก็สามารถประเมินผลงานตัวเองและพัฒนาระบบต่อเนื่องได้นานถึง 8 ชั่วโมง

- ทำงานแบบไม่หยุดกลางคัน: ออกแบบมาให้ “คิด-ทำ-วัด-ปรับ” ได้อย่างต่อเนื่อง ไม่หมดมุกเมื่อเจอโจทย์ยาก

จะเริ่มต้นใช้งาน GLM-5.1 ได้อย่างไร?

GLM-5.1 เปิดให้ใช้งานฟรีแบบโอเพนซอร์สภายใต้ใบอนุญาต MIT ทำให้สามารถดาวน์โหลด weights ได้ฟรีและนำไปปรับใช้เชิงพาณิชย์ได้ทันที

ช่องทางเข้าถึงและรองรับการทำงาน:

- ดาวน์โหลดโมเดล: HuggingFace และ ModelScope

- API ใช้งานทันที: api.z.ai และ BigModel.cn

- รองรับ Inference Frameworks: vLLM และ SGLang

- ทำงานร่วมกับเครื่องมืออื่น: Claude Code และ OpenClaw

GLM-5.1 เหมาะกับธุรกิจหรือทีมพัฒนาแบบไหน?

GLM-5.1 เหมาะที่สุดกับองค์กรที่ต้องการระบบ AI ที่ทำงานแบบ “มาราธอน” ไม่ใช่แค่ “สปรินต์” เช่น

- ทีม DevOps ที่ต้องการระบบอัตโนมัติสำหรับปรับแต่งและตรวจสอบฐานข้อมูล

- สตาร์ทอัพที่ต้องการสร้าง MVP แบบวนลูปพัฒนาอย่างรวดเร็ว

- องค์กรวิจัยที่ต้องการโมเดลสามารถรันการทดลองซ้ำๆ โดยไม่ต้องคอยสั่งงานทุกขั้นตอน

- นักพัฒนาที่ต้องการสร้าง AI Agent ที่สามารถเรียนรู้และปรับปรุงกลยุทธ์ได้เอง

คำถามที่พบบ่อย (FAQ)

Q: GLM-5.1 ต่างจาก GPT-5.4 หรือโมเดลทั่วไปอย่างไร? A: GLM-5.1 ออกแบบมาเพื่อ “Agentic Workflow” โดยเฉพาะ สามารถทำงานวนลูป “คิด-ทำ-วัด-ปรับ” ได้ไม่จำกัดรอบ ในขณะที่โมเดลทั่วไปมักหยุดหลัง 50-100 รอบ ทำให้ GLM-5.1 เหมาะกับงานที่ต้องการความต่อเนื่องและปรับปรุงตัวเองได้

Q: GLM-5.1 ใช้งานฟรีจริงหรือไม่? A: ใช่ GLM-5.1 เผยแพร่ภายใต้ใบอนุญาต MIT ทำให้สามารถดาวน์โหลด ใช้งาน และปรับแต่งได้ฟรี ทั้งสำหรับงานวิจัยและเชิงพาณิชย์

Q: ต้องการทรัพยากรระบบระดับไหนเพื่อรัน GLM-5.1? A: โมเดลรองรับ Inference Frameworks ยอดนิยมอย่าง vLLM และ SGLang ซึ่งช่วยเพิ่มประสิทธิภาพการรัน สามารถปรับขนาดการใช้งานได้ตามทรัพยากรที่มี ตั้งแต่เครื่องพัฒนาทั่วไปไปจนถึงคลัสเตอร์เซิร์ฟเวอร์

Q: GLM-5.1 รองรับภาษาไทยหรือไม่? A: โมเดลมีความสามารถด้านหลายภาษา (multilingual) แต่สำหรับงานเฉพาะทางภาษาไทย แนะนำให้ทดสอบกับข้อมูลจริงและพิจารณาทำ Fine-tuning เพิ่มเติมเพื่อผลลัพธ์ที่ดีที่สุด

ข้อสรุป:

GLM-5.1 คือ AI ที่ไม่ยอมแพ้กลางทาง ยิ่งให้มันคิด-ทำ-ปรับ นานขึ้น ผลลัพธ์ยิ่งดีแบบก้าวกระโดด เหมาะกับคนทำธุรกิจที่ต้องการระบบที่วิ่งมาราธอนได้จริง ไม่ใช่สปรินต์แล้วหมดแรง